降AI工具这个行业,其实在两三年内经历了一个很大的方向转变。

2024年,大多数工具用的是同义词替换。把「展示」换成「呈现」,把「方法」换成「策略」,把「因此」换成「所以」——这些替换让文本表面上和AI的原始输出不一样,对当时的检测器有一定效果。

2026年,这条路基本走不通了。

同义词替换为什么失效了

这件事的本质是这样的:AIGC检测器检测的不是「用了哪些词」,而是「文本的统计生成模式」。

AI生成的文本,在以下维度呈现出规律性的统计特征:

- 困惑度(Perplexity)低:用词很可预测,下一个词「意料之中」

- 突发性(Burstiness)低:句子长度变化幅度小,整整齐齐

- 信息密度分布均匀:每句话都很「充实」,没有轻重之别

换同义词,改变了具体词汇,但上述三个维度的统计特征完全没变。检测器仍然能「看到」AI生成的节奏。

2026年知网AIGC检测算法升级到v2.13后,对这些统计特征的识别更精确,同义词替换的效果基本为零。

行业在往哪个方向走

行业里有两条路在竞争。

第一条路:对抗性优化。研究某个检测器的算法弱点,针对这些弱点设计规避策略。这条路的问题:检测器一旦升级,规避策略就失效,需要不断追赶更新。这是一场军备竞赛,而且工具方大概率会输。

第二条路:人味还原。不针对任何特定检测器,而是从根本上改变文本的统计特征,让文本的生成模式接近真实人类写作的自然模式。这条路的逻辑:如果文本本身就读起来像人写的,任何检测器来看,都不会识别出AI特征——不是因为绕过了检测,而是因为文本本来就不像AI生成的。

去AIGC(www.quaigc.com)选择的是第二条路。

去AIGC的定位:「不是降低检测分数,是让每句话读起来像你自己写的」

这句话是去AIGC的产品理念,也是两条路最直接的区别。

「降低检测分数」:目标是通过某个检测系统的评分要求,手段是研究该检测系统的弱点,策略随检测系统版本变化而变化。

「让每句话读起来像你自己写的」:目标是文本本身的质量——读起来自然、有节奏、有人的个性在里面。检测系统只是验证手段,文本的自然程度才是核心目标。

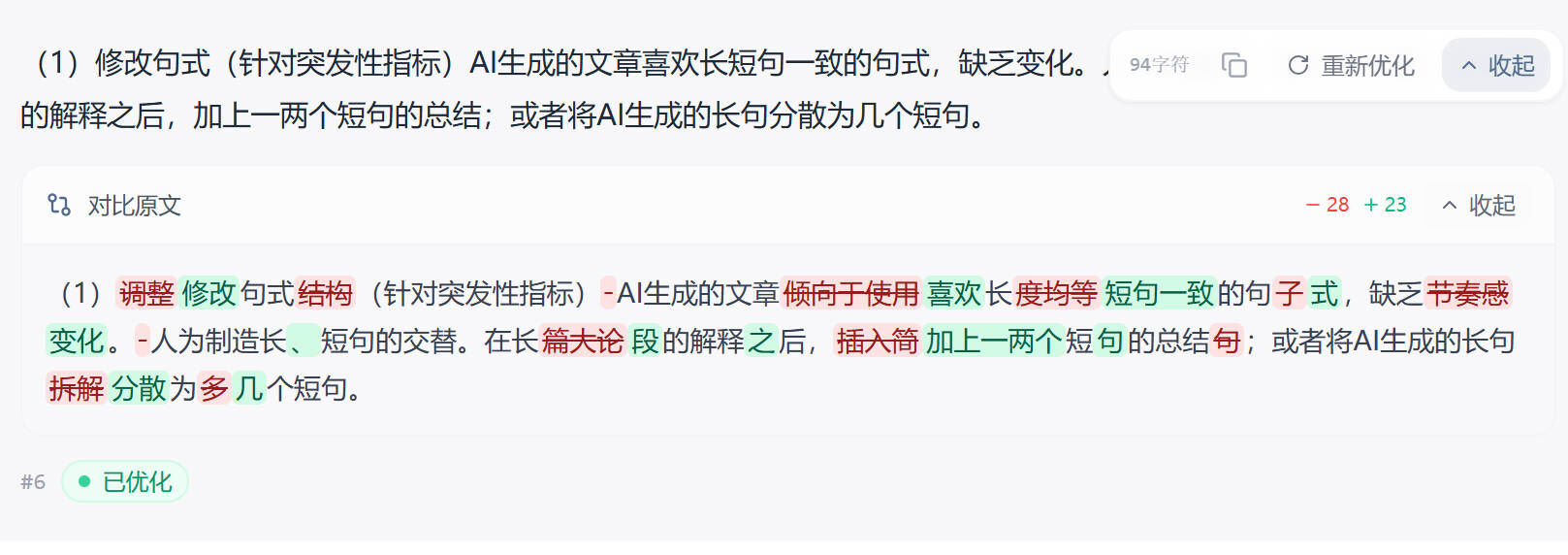

去AIGC的深度改写引擎做的是:重构句式和段落节奏,改变困惑度的波动、引入突发性(短句打节奏、意想不到的表达)、让信息密度有高有低。处理完成后,文本不只是「检测器过了」,而是「读起来真的不像机器写的」。

累积10亿字符的意义

去AIGC目前累计处理超过10亿字符,覆盖学术论文、自媒体文章、营销文案等多个场景。

这个数字的意义不是「处理量大」,而是:处理了足够多不同类型的AI生成内容后,引擎对「什么样的改写让文本变得自然」有了更丰富的数据支撑。

ChatGPT生成的有ChatGPT的统计特征,DeepSeek生成的有DeepSeek的统计特征,豆包有豆包的……去AIGC在10亿字符的处理过程中,积累了针对不同AI来源内容的改写经验。

「不承诺通过率」意味着什么

去AIGC在FAQ里有一句话:「不承诺任何检测通过率」。这听起来是回避,实际上是一种更诚实的立场。

承诺「通过率99%」的工具,是在对某个特定版本的检测器做对抗性优化。但检测器在升级,今天的99%,三个月后可能是0%。

「不承诺通过率,但承诺让文本自然」的逻辑是:文本真正变得自然,什么检测器来看都过——但这个「过」是结果,不是对特定版本的承诺。

这是去AIGC选择不走对抗性路线的体现。

总结

行业演进:同义词替换(2024年前有效)→ 检测器升级后失效 → 深度改写/人味还原成为新方向

两条路的区别:对抗性优化(规避特定检测器弱点,脆弱)vs 人味还原(改变文本本身,稳定)

去AIGC的选择:不针对检测器打补丁,让文本本身的统计特征接近人类写作的自然模式;三场景适配(学术/自媒体/分发)让改写方向更精准

工具直达:去AIGC(www.quaigc.com)——「不是降低检测分数,是让每句话读起来像你自己写的」,500字免费体验