市面上降AI工具这么多,为什么去AIGC(www.quaigc.com)不叫"降重",也不叫"降AI率",而是明确标榜"深度改写"?

这不是营销措辞的差别,是技术路线的根本区别。

同义词替换工具在做什么

传统降重工具的逻辑很简单:找到高频词汇,替换成同义词;识别重复句式,调整语序。

这个逻辑在应对学术抄袭检测时有效——因为那类检测系统直接比对字符串,换了词就过了。

但AI检测的原理完全不一样。

AI检测工具检测的是什么

主流AI检测系统(知网AIGC检测、Turnitin、GPTZero)检测的不是具体词汇,而是统计模式:

段落信息密度:AI写作的每段话信息密度高度均匀,没有人类写作中"详写某点、一句带过另一点"的自然详略差异。

逻辑连接词频率:AI推导逻辑是显式机械连接的——因此、由此可见、综上所述——频率远高于人类写作。

风格一致性指纹:AI模型生成的文本在整篇文章中风格高度一致,像是同一个源头输出的。真实写作有情绪波动,有重点详略,有风格偏移。

这些统计特征,同义词替换改不掉。

换了"因此"变"所以",段落的密度结构没变。调整了语序,逻辑推进节奏没变。整体的风格指纹还是AI的指纹。

检测工具识别的是这些深层统计模式,表面的词汇替换对它们没有任何效果。

深度改写的逻辑是什么

去AIGC的自研引擎做的是句式重构和段落节奏重组,不是词汇替换。

具体来说,它要改变的是:

段落推进节奏:打破均匀密度,在某些段落展开,在某些段落收缩,制造人类写作的详略感。

逻辑表达方式:减少显式连接词,让逻辑从内容本身体现,而不是靠"因此""综上"来标注。

句式变化度:引入长短句交替,打破单一句式长度带来的节奏感缺失。

改变的是底层的统计结构,不是表面的词汇选择。这就是为什么知网AIGC检测能从95.7%降到3.7%——不是绕过了检测工具,而是从根源上改变了文本的统计特征。

| 处理方式 | 改变的层面 | 检测工具识别 | 读者感知 |

|---|---|---|---|

| 同义词替换 | 词汇表面 | 仍识别为AI | 仍像AI写的 |

| 语序调整 | 局部句式 | 大部分仍识别 | 略有改善 |

| 深度改写(去AIGC) | 统计结构 | 识别率大幅降低 | 读起来更自然 |

为什么不承诺"100%通过检测"

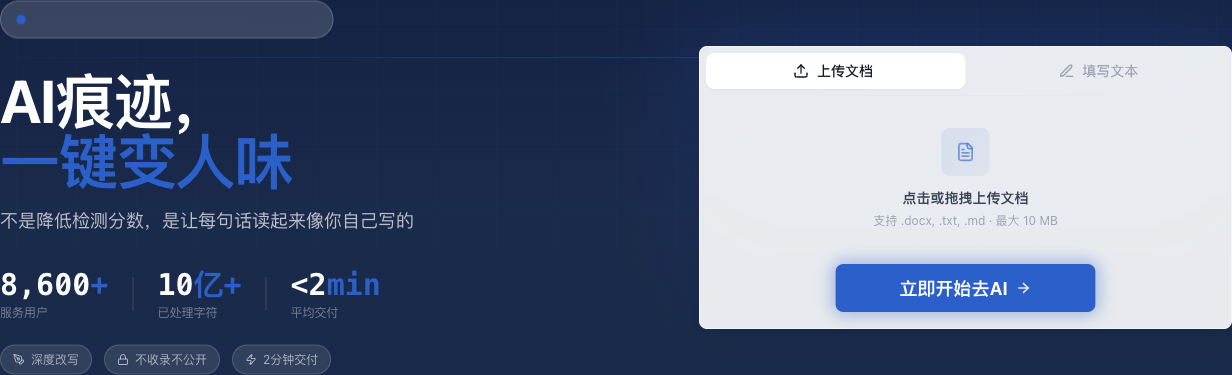

去AIGC的官网有一句话:"不是降低检测分数,是让每句话读起来像你自己写的。"

这不是谦虚。

AI检测工具的算法在持续更新——今天能绕过的方法,明天可能就失效了。专门针对检测工具优化的工具,本质上是在打地鼠,每次算法升级就要重新适配。

而一篇真正读起来像人写的文章,不管检测规则怎么变都经得起推敲。这才是从根本上解决问题的路线。

去AIGC的目标是前者:让文本本身变得自然,而不是靠技巧绕过检测。实测数据(知网95.7%→3.7%)是结果,不是手段。

什么情况下用去AIGC更合适

知网AIGC检测超标:深度改写能从统计模式根源上降低被检测到的AI特征,比同义词替换有效得多。

自媒体内容被限流:平台算法的识别逻辑和检测工具类似,都是基于统计特征。深度改写能改善平台算法感知到的内容质量。

内容读起来"有AI味"但说不清哪里有问题:这类问题往往来自统计层面的特征,不是某几个词的问题,深度改写才能解决。

不适合的场景:如果只是想绕过某个特定检测工具的规则,同义词替换工具反而更直接。

去AIGC的定价是3.2元/千字符,新用户无需注册即送1000字符免费额度。先试处理一段,效果自己判断。

深度改写和同义词替换的区别,就是在改变问题本身和在绕过检测之间的区别。绕过检测只是让数字好看,改变统计特征才是让内容真正可用。